2026年AI提示词工程全指南:从“咒语”到“上下文架构”的深度演进

紫喵API服务 的 AI API 使用建议

紫喵API服务 面向需要 OpenAI 兼容接口、Claude/Gemini/GPT 多模型切换、包月额度管理和图像模型调用的用户。阅读本文后,可以结合本站的模型清单、独立使用文档和个人面板,把教程内容直接落到实际调用流程中。

2026年AI提示词工程全指南:从“咒语”到“上下文架构”的深度演进

如果说2024年是世界发现生成式AI的一年,那么2026年则是AI进入生产级架构的成熟年。曾经被视为“魔法咒语”的提示词工程(Prompt Engineering),如今已正式演变为一门严谨的学科:上下文工程(Context Engineering)。

根据最新统计,2026年已有92%的开发者每天使用AI编程工具,全球41%的代码由AI生成。在这个时代,平庸的提示词与卓越的提示词之间的差距,不再仅仅是便利性,而是工程交付的速度与质量。

一、 核心转型:从“写提示词”到“架构上下文”

提示词工程的声誉曾因过度玄学而受损——“假装你是一个专家”或“一步步思考”曾被奉为圭臬。但在2026年,这一领域已发生根本性转变。

LLM即CPU,上下文即RAM

Andrej Karpathy提出了一个被广泛接受的心理模型:大语言模型(LLM)是中央处理器(CPU),而上下文窗口则是随机存取存储器(RAM)。提示词工程的任务不再是磨炼辞藻,而是作为操作系统的调度员,精准地决定哪些信息、指令和示例应该在何时加载到RAM中。

解决“迷失在中间”问题

研究表明,即便拥有百万级的上下文窗口,LLM的推理性能在超过3000个Token后也会显著下降。这就是著名的“Lost in the Middle”现象:模型对输入信息的开头和结尾关注度最高,而位于中间的信息往往被忽略。因此,高效的开发者更倾向于控制上下文的密度,而非一味增加其长度。

二、 150-300字法则:黄金长度的奥秘

实证研究一致表明,提示词的最佳长度在150到300字之间。超出这个范围,往往会陷入边际效用递减甚至负回报。这并非因为模型处理不了更多字数,而是因为在这个范围内,信息的信噪比最高,注意力偏差最小。

应用技巧:

- 核心指令放在两头: 最重要的任务说明置于开头,关键的输出限制置于末尾。

- 精简中间内容: 避免在提示词中部堆砌无关紧要的描述。

- 动态加载: 如果需要大量示例,应通过RAG(检索增强生成)动态获取,而非一次性塞入。

三、 四大上下文工程策略

为了在生产环境中实现极致的AI表现,你需要掌握以下四种策略:

- 写入(外部持久化): 不要试图在上下文窗口中保存一切。将知识存储在向量数据库(如Pinecone、Weaviate)中,只在需要时加载。

- 选择(精准检索): RAG不仅仅是聊天机器人的专利。在2026年,精准的块大小(Chunk Size)控制在512-1024 Token,并结合20%的重叠,是保证检索质量的标准做法。

- 压缩(摘要提取): 在处理长对话历史时,使用廉价模型(如Gemini Flash-Lite)先对历史进行结构化摘要,再喂给主模型。

- 隔离(代理独立上下文): 不要让一个庞大的提示词处理所有任务。将规划、执行、测试等环节分配给不同的AI代理(Agents),并为每个代理提供独立的、干净的上下文环境。

四、 2026主流模型特定策略手册

在2026年,针对不同模型家族采用差异化策略是提升性能的关键:

Claude (Anthropic): 字面执行者

- 使用XML标签: 使用

<instructions>、<context>、<example>等标签,其效果远好于Markdown。 - 保持语气中立: 避免使用“极其重要!”等激进词汇,Claude在冷静、直接的指令下表现更佳。

GPT-5 (OpenAI): 路由型通用模型

- 触发推理模式: 使用“深入思考(Think hard about this)”等词汇会自动触发其内置的推理模型(如o1/o3系列)。

- 避免手动提示CoT: GPT-5已有原生推理链,显式的“一步步思考”指令有时反而会干扰其内部逻辑。

Gemini (Google): 长文本与多模态专家

- 示例为王: 与GPT-5不同,Gemini在有示例(Few-shot)的情况下表现显著优于零示例(Zero-shot)。

- 多模态优势: Gemini擅长UI分析和图表解读,适合处理复杂的视觉推理任务。

五、 提示词工程化:像对待代码一样对待提示词

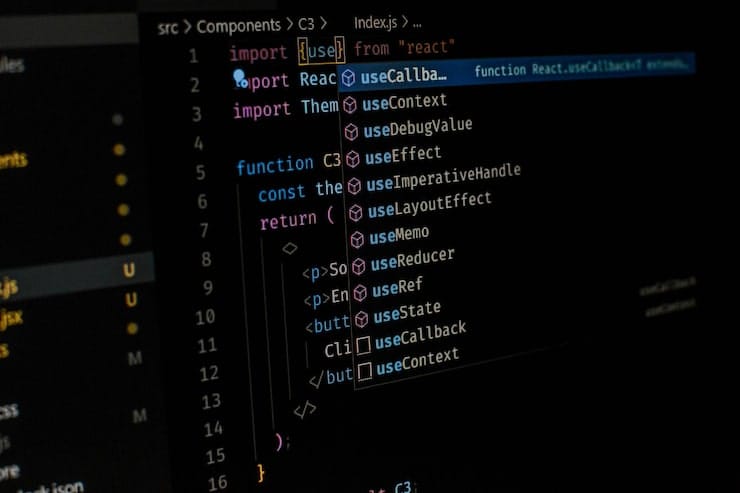

在2026年,优秀的开发者不再在对话框里调试提示词,而是将其纳入软件工程流程:

- 版本控制: 所有的系统提示词(System Prompts)都应存储在Git中,并随代码一同进行版本迭代。

- 回归测试: 建立一份包含代表性输入和预期输出的“金色测试集”。每当修改提示词,必须运行测试集以防性能倒退。

- 缓存优化: 将静态指令放在前面,动态内容放在后面,以利用Anthropic和OpenAI的上下文缓存(Context Caching)功能,最高可降低90%的成本。

总结

2026年的AI提示词工程已经告别了感性与直觉,转向了理性的信息架构。正如Shopify CEO Tobi Lütke所言:“上下文工程是为AI提供解决任务所需的完整信息环境的艺术。”

未来的领先者不再是那些能写出华丽提示词的人,而是那些能够精准管理上下文、编排多代理协同、并以工程化手段持续优化AI输出的开发者。你,准备好升级你的“RAM管理”技能了吗?

本文内容综合自Fungies.io、Prompt Bestie及Daily Neural的2026年最新研究报告。

在本站快速上手 Claude / GPT

本文涉及的能力可以直接在本站的中转 API 上调用,兼容 OpenAI / Anthropic 官方 SDK:

无需科学上网,国内可直连,5 分钟完成接入。